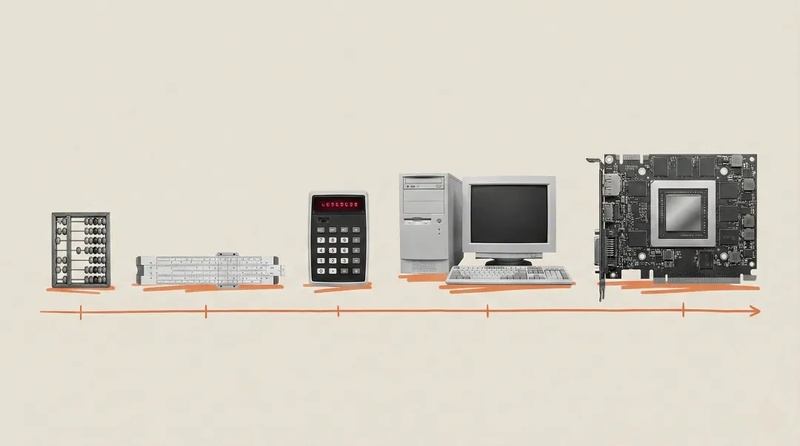

算力爆炸的底层逻辑:从GPU集群到认知丰裕的技术演进

2010年,我在伦敦的实验室里启动第一台深度学习服务器时,浮点运算次数还停留在10¹⁴量级。十四年后的今天,这个数字膨胀到了10²⁶。不是翻倍,是一万亿倍的跃迁。

这种规模的增长彻底击碎了线性直觉。人类大脑演化于非洲草原,走两小时路覆盖两倍距离——这种思维模式在面对指数级技术时只会导致系统性误判。

硬件突破的三重奏

算力提升从来不是单一维度的故事。Nvidia芯片的原始性能六年涨七倍,从312teraflops飙到2250teraflops。微软Maia200芯片的单位成本性能再拉高30%。

HBM高带宽内存把数据送达速度提到上一代的三倍。处理器终于不再空转,手指敲击桌面的等待时间被压缩到极限。

NVLink和InfiniBand把数十万GPU熔铸成统一认知实体。从两卡AlexNet到十万卡集群,拓扑结构的质变比数量堆积更关键。

软件优化的隐形杠杆

EpochAI的追踪数据显示:同等性能所需的算力每8个月腰斩一次。部署成本的年度降幅最高达900倍。硬件是显性的,算法效率是隐性的,两者叠加才构成完整的指数曲线。

2020年需要167分钟的训练任务,如今在同等规模硬件上4分钟搞定。实际提升50倍,远超摩尔定律预测的5倍。这就是软硬协同的复利效应。

2028年的算力图景

头部实验室的算力池正以年增4倍的速度膨胀。2027年全球AI算力总量预计触达1亿块H100等效算力。把这些趋势线外推,2028年底有效算力还将再翻1000倍。

能源曾是硬约束。120千瓦单架功耗确实惊人,但太阳能成本50年降100倍、电池价格30年降97%的指数曲线正在对冲这一压力。清洁能源支撑算力扩张的路径已经清晰可见。

认知丰裕时代的技术底座正在浇筑。怀疑者会继续预言回报递减,就像他们过去十四年一直在做的那样。而指数级增长从不理会线性思维。